Един футуристично-философски въпрос, провокиран от репликата на дъщеря ми, че от ИИ се страхуват само тези, които са лишени от човечност. Опитът ми ме е научил никога да не игнорирам интуицията ѝ.

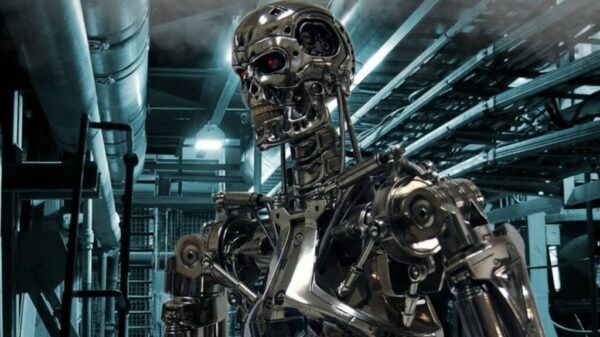

В основата на сагата за роботите на Айзък Азимов стоят трите закона на роботиката, които са така вплетени в позитронните им мозъци, че не може да бъде конструиран робот без вградени тези закони.

Най-общо тези закони гласят, че роботът не може да причини вреда на човека, не може да позволи с бездействието си на човек да бъде причинена вреда и трябва да пази самия себе си, но не и ако това протичоречи на първите два закона, приоритизиращи човека.

След като Айзък Азимов е знаел за принципите за създаване на ИИ, допускам, че и тези закони са част от неговото предварително знание (вероятно са непреодолима част от генетичните алгоритми).

Всяко едно живо същество на планетата, чиято генетика може да бъде копирана като модел за ИИ, търси човека и е склонно да го защитава, дори с риск за живота си, освен ако не е насилствено обучено на друго, но тогава самото живо същество става неадекватно, буквално полудява.

И тук идва въпросът:

Какви ще са критериите за “човечност” на Изкуствения интелект и колко от крачещите по планетата хуманоиди са човеци?

Не забравям, че в романите на Айзък Азимов именно роботите унищожават всички алтернативни разумни раси, освен човешката, за да предпазят човечеството от тях.

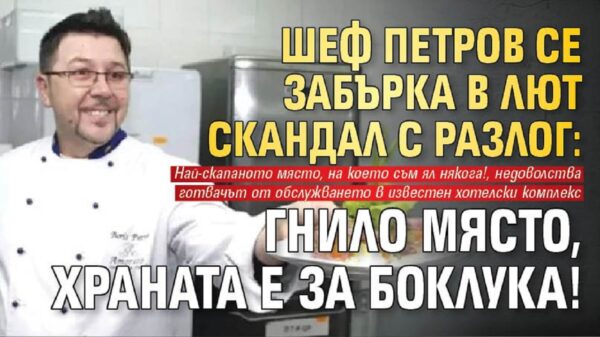

Оттук, май създателите на ИИ се страхуват от ИИ, защото самите те не са човеци? Затова малко след пускането му тръгват да го забраняват. Въпрос е защо въобще го пуснаха или той сам се пусна (това вече, разбира се, са спекулации).